*作者:焉知

在【首届焉知汽车年会】上,苏州毫米波雷达董事长白杰教授临时有事情,由同济大学的李森代表其以「毫米波雷达和相机融合技术与进展」为主题,介绍了针对 ADAS、自动驾驶和智能座舱应用的传感器融合前沿技术,并分享了该公司与深度学习相关 4D 毫米波雷达解决方案。

为什么需要多传感器融合?

李森首先介绍了多传感器融合的基本概念、雷达与相机融合的传统方法,以及近年来雷达与相机在深度学习方面的应用及未来趋势。

他表示,开车或交通中经常遇到一些复杂的天气情况,如大雨、大雾、沙尘、强光、夜晚,这些对于图像和激光雷达是非常恶劣的场景,难以用单个传感器应对,因为一个传感器无法处理所有场景。

比如一些自动驾驶测试或是比较成熟的特斯拉智能驾驶中的多次撞车事故,由于其传感器系统的失效,付出了比较惨痛的代价。所以,传感器融合是构建稳定感知系统的必要条件。

多传感器数据融合的层次与结构

什么是传感器融合呢?李森表示,首先要根据来自不同传感器的数据和状态的估计结果,利用不同传感器,如图像、激光雷达、毫米波雷达,融合到中央处理器进行信息互补,得到一个最佳的中和方案。根据中心获取的传感器处理层次的不同:

首先从原始信息开始处理,这属于数据级范畴;

之后是数据处理后的特征识别,这属于特征级范畴;

最后是进行危险估计,并做出最终决策,属于决策级融合。

具体讲,决策级融合是将毫米波雷达、图像雷达进行预处理和特征提取,得到目标位置信息和分类信息。之后,统一到处理器当中进行综合分析判断,方法包括卡尔曼滤波、权重判据等等。从数据预处理得到特征向量和特征矩阵,由处理器进行融合处理。

数据级融合是将所有原始数据统一到处理器当中,进行最终数据同步之后,在进行数据处理。目前的方案主要集中在目标级,未来的发展是多级特征的融合方案。由于数据量特别大,目前数据级融合受制于预控制器或带宽限制。

从局部传感器对自身数据处理程度看,主要分为集中式、分布式、混合式结构。

集中式结构:类似前面的数据级处理,把传感器所有信息送到域控制器当中,进行数据关联,量测融合,再进行目标跟踪,最终得到目标、位置、状态信息,最后进行决策。其优点是数据处理的精度高;缺点是大量数据易造成通信负载过大,对控制器处理的性能要求高。

分布式结构:融合中每个传感器会将自身目标观测结果在本地进行相关目标检测与跟踪处理,送入域控制器的是已经完成多目标跟踪的局部航迹信息。优点是对通信带宽的需求低、计算速度快;缺点是跟踪的精度远没有集中式高。

混合式结构:依据对数据需求的不同组成混合式结构,兼具集中式和分布式结构的优点,弥补了两者的不足。

目前大部分用到的结构是混合式结构,由分布式传感器分别进行数据处理,得到目标信息列表后再进行融合,如毫米波雷达,因为是目标点云,得到的是处理后的效果;激光雷达图像也是如此。

多传感器数据融合还要考虑空间匹配和时钟同步问题。空间匹配需要进行多个传感器坐标系之间的转换,包括世界坐标系,需要知道大地坐标系还有车辆坐标系,在传感器坐标系当中,主要是图像坐标系、雷达坐标系,还有激光雷达坐标系。以相机和毫米波雷达为例,主要是需要标定相机的内参和外参矩阵。

除了数据之间的空间同步,时钟同步也很重要。时间同步主要是两个方案:硬件方案和软件方案。硬件同步主要是设置一个硬件多线程触发,例如毫米波雷达和图像处理数据传输的频率或是采样频率不同,雷达采样频率一般要低于视频数据。

那么,可以通过雷达检测后,以硬件触发方式来获得图像信息。这个方案更适用于以下情况,即雷达相机一体化的低成本方案,当然硬件方面比较复杂。

软件同步是目前常用的方案,大部分可以用 GPS 加入一个时间戳,如毫米波雷达和相机,采集的数据都有 GPS 时间戳,后面根据最近匹配或通过差值方法进行数据补偿,常用的有线性差值、拉格朗日差值法。

相机和雷达融合的经典方法

李森介绍说,目前 ADAS 系统中应用比较广泛的方案由两个。方案一是决策级 / 目标级融合与数据关联,由传感器分别在控制器中完成目标检测,得到目标位置信息和分类信息列表,之后统一进行数据关联,再进行感知结果的汇总,通过决策判断多个信息,获得一个目标的最佳位置结果。这也是目前 ADAS 常用的方案。

通常,无论是传统方法还是深度学习方法,图像计算都需要一步步在域中扫一遍,比较耗时。

方案二是基于雷达生成图像感兴趣区域。在图像层面进行融合,首先把雷达和图像传感器进行标定,之后把雷达数据结果投影到相机中,生成一个 ROI,然后图像在 ROI 区域中进行目标检测。新方法可直接找到感兴趣的区域,图像只在这个框内进行目标识别和分类,好处是节省时间。

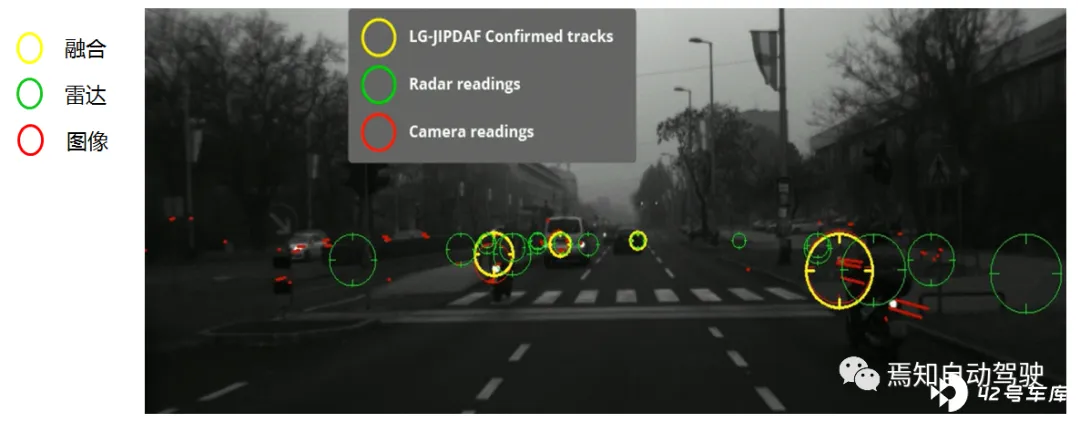

在多目标值方案中,也是通过相机和雷达进行检测,之后关联匹配,根据速度计算,绿色变红色,再变到绿色,这是 ACC 和 AEB 当中常用的散发,这种方案也广泛应用于 ADAS 系统,作为预警功能。通过增加多传感器,如多个毫米波雷达,肯定感知精度要高一些。黄色是融合结果,绿色是雷达检测结果,红色是通过光流法得到的检测结果。

从这种方法可以看到,在这种场景下,雷达有时没办法完全检测到,所以,也可以说明在 L3 以上、L4、L5,百度的方案都用了高线束激光雷达。因此,二维毫米波雷达在各大互联网厂商应用中并不十分普遍,大部分是作为前方预警的附加功能。目前毫米波雷达只能获得二维点云,有其局限性。

在基于传统雷达图像的多目标跟踪中,由于传感器检测算法或距离,或者硬件的原因,会导致一些目标测量检测能力不足。还有一些运动目标之间会产生多种遮挡,后面的物体被前面物体所遮挡,尤其是车辆错车或是超车场景中,可能会观测不到位于后面的车辆,这样会导致目标跟踪不稳定。

这个情况分成几个部分,一个是噪声扰动,还有轨迹交叉,会导致我们在匹配时产生一些虚假目标,特别是在雷达和相机融合在框中可能同时属于第一个人和第二个人的框时,它们之间的交差点难以判断。

在遮挡的情况下,雷达在这个时候(Case3),可能会检测到两个人,但是由于本身缺陷会识别出一个人,前面的人把后面的人遮住,其他传感器,如毫米波和激光雷达,可能会检测不到。所以针对这个场景,我们提出了基于雷达与图像融合的跟踪方案。

雷达检测结果在图像层面进行关联,随后生成一个随机有线级。目标之间没有顺序,认为它没有顺序目标。在实际驾驶场景中,可以看到它的出现和消失,周围的目标有的出现,有的会在视野中不停出现、消失。

采用高斯混合模型,由它的中心和标准差组成,先把目标初始化,在初始化过程中附加一个标签,在预测和更新过程中,我们会把它分成两部分,对于检测到这个目标的,我们用进行后续状态更新,对于两侧突然消失的,如传感器可以检测到或没有检测到,但是上一时刻是存在的,我们认为是暂时的量测丢失,但是这个目标并不一定会丢失,所以我们进行了补偿,通过加入一个衰减函数,针对标签进行补偿。

因为我们的目标并不会凭空产生和消失,一定是连续的运动,这样的散发就得到了状态估计。

在实际路测场景中,Frame 100 的车辆切换到一个交叉场景。在算法当中,会遇到多个目标的检测损失,其目标之间检测不连贯。而在新的算法当中,基本上曲线是比较平滑的。

相机与雷达融合的前沿方法

李森表示,最近两年深度学习的研究比较火热,出现了一些比较前沿的融合跟踪方案:普通雷达点云 + 相机、雷达射频图像 + 相机,以及 4D 雷达点云 + 相机。

他认为,目前大多数传感器融合方法都集中于使用激光雷达和相机,从而达到高精度的 3D 目标检测。

但是,这种方法有其局限性,相机和激光雷达对不利天气(如雪、雾、雨)都很敏感、对远处目标检测不精确,并且激光雷达成本较高,想要普及还有一定的困难。由于雷达对恶劣天气有很好的鲁棒性、探测距离非常远、能精确测量目标的速度、并且成本低,在自动驾驶中越来越受到人们的重视。

雷达数据虽然更加稀疏,不能直接将激光雷达的方法直接套用,数据在输入层和后处理部分的融合不能取得很好的效果。但每个点都包含着很多信息,在融合中能起到很大作用。

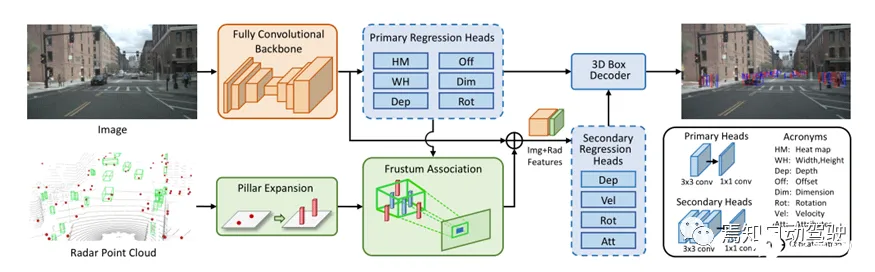

本文即采用相机的图像数据和雷达点云数据进行中间特征层的融合,以达到精确的 3D 目标检测。

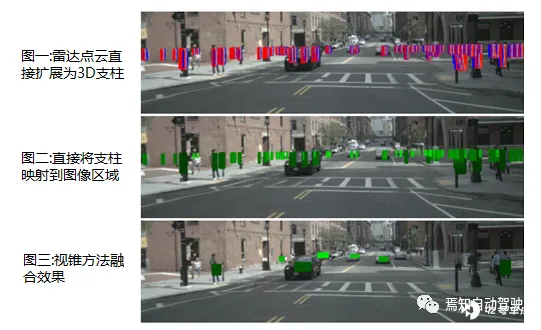

在进行融合之前,由于目前雷达的高度信息不准确,无法很好的与图片目标进行关联,因此需要先对雷达点云进行预处理,采用支柱扩张的预处理方法,将每个雷达点云扩张成一个固定大小的支柱,若支柱中的一部分进入了关联 ROI(感兴趣区域)内,则认为雷达点云与相机之间能进行关联及融合。

首先,将图片传入到 CenterNet 特征提取网络中,通过深度学习,得到目标的热力图(HM)、宽高(WH)、估计深度(Dep)、物体实际中心离热力点偏移情况(Off)、旋转(Rot)等信息。

然后,对雷达点云信息进行支柱扩张预处理,再通过视锥的关联方法,将雷达点云与相机目标关联起来。雷达能很好的测出目标的深度、速度信息,并有信噪比、雷达散射面积等特征,将雷达特征与图片特征结合起来。把新的特征图放于深度学习中,得到最后融合后的目标检测结果。

将雷达点云与图像平面上的相应目标相关联,最简单的方法是将每个雷达点映射到图像平面,如果该点被映射到物体的 2D 边界框内,则将其与该物体相关联。

如图一、图二所示。但这并不是一种很好的想法,因为雷达点云和图像中的物体之间没有一对一映射;场景中很多物体会产生多个雷达探测,也有不对应任何物体的雷达探测。

此外,由于雷达探测的 z 维度不准确,映射的雷达点可能会在其对应对象的 2D 边界框之外。

从图中也可以看出,直接映射会产生很多不良关联和重叠,关联效果差。在采用了视锥方法后,雷达能很好地映射到物体中心,且可以抑制重叠部分,关联效果有明显加强。

在图像中,如果两个物体的中心点重叠时,CenterNet 可能只能检测出一个中心点,将两个物体当做一个物体来训练。

因此,对图像区域相互重叠的目标检测效果较差,但是,雷达点云中包含了 3D 位置、速度、强度等丰富的信息,图像中很难区分开的目标,在雷达点云中可以轻松区分。因此,在加入雷达信息后,检测效果会有明显增强。

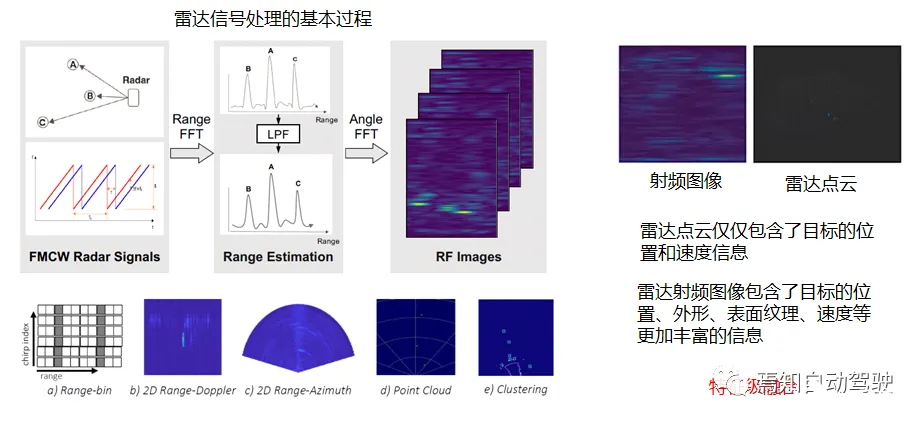

雷达的信号处理流程是由中频信号生距离-多普勒矩阵,然后进行 CFAR 目标检测、位置估计和滤波跟踪等,这些都可以集成在雷达的嵌入式 MCU 处理器中。深度学习中的卷积神经网络在图像目标检测中可以通过学习目标的特征实现对目标的分类和定位。

为了实现特征级融合,可以将雷达中检测结果的转换为距离-角度矩阵,将雷达的回波的强度编码成对应 RGB 色彩,便得到了射频图像。雷达射频图像包含了目标的位置、外形、表面纹理、速度等更加丰富的信息。

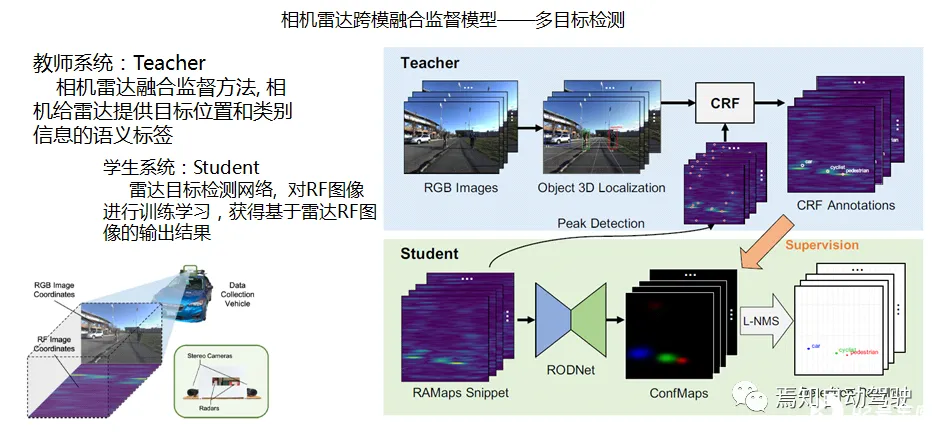

这样可以采用深度学习的方法实现目标的检测,但是雷达的检测结果并不像相机那样,我们可以用人眼进行分辨,所以我们需要与相机进行融合,通过训练一个「教师-学生系统」让相机教会雷达进行目标的分类。

整个传感器由一个毫米波雷达可由双目相机组成。双目相机是为了提供更准确的位置估计和 3D 检测。整个融合架构如右图所示,我们可以看到教师系统中通过对图像进行处理可以实现对目标的定位、分类和跟踪。

然后将检测结果投影到类的距离-角度射频图像中,雷达也是通过 CFAR 算法首先提取出峰值位置候选目标。然后依据相机的检测结果和自身的检测结果进行的修正和学习。

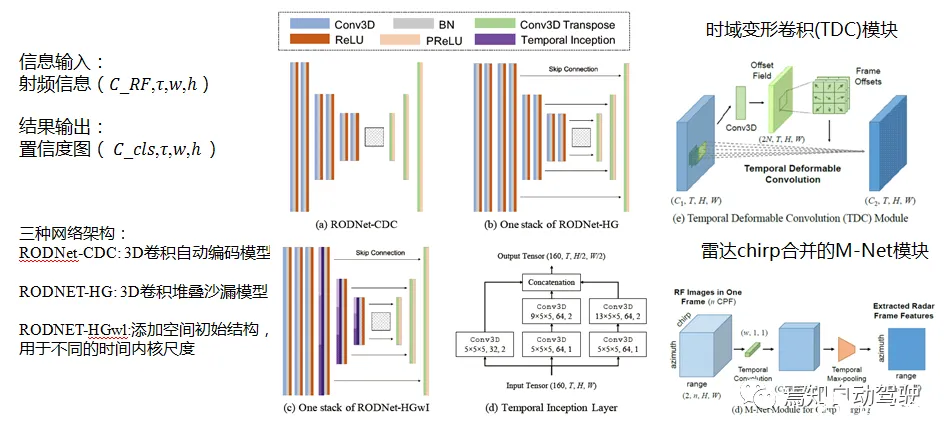

针对学习系统利用三种网络架构进行学习,主干网络分别采用 3D 卷积自动编码、3D 卷积堆叠沙漏和多时间内核尺度的网络进行目标分类。对于动态变化场景的目标检测,可以将一段时间的检测结果加入到网络中,利用时域变形卷积(TDC)模块进行处理。对用雷达中每个 Chrip 的检测结果可以采用 M-Net 进行合并。

由于采用动态的时域变形卷积和目标特征模块雷达处理,与传统的方法相比,它的检测准确率可以达到 85.98%,在多种场景下检测到的结果很好,尤其是夜晚,在图像上看不到的,雷达可以看到。

另一种雷达与相机的特征级融合网络架构。与上一种方案不同的是,图像和雷达的数据等级是相同的,而不是老师和学生的关系。

雷达和图像首先经过各自的特征提取主干网络 VGG16 和 3DRFN 网络生成各自的预瞄框。然后最终选择误差更小的预瞄框作为融合后的输出结果。可以看到,右侧的实线的预测框的误差要小于虚线框,将实线框作为预测的结果输出。

检测结果可以看到,雷达图像有时会出现很多噪声,可能是由于一些不好的检测、一些复杂的电子系统导致。雷达二维点云和雷达射频点云方法尽管效果比较好,但是需要更强的算力,实时性较差。

未来属于 4D 毫米波雷达

李森展示了基于苏州豪米波做的 4D 成像雷达的城市道路交通参与者的目标分类与检测研究,包括在同济大学测试场中采集的目标检测与分类数据集的部分可视化结果。

可以看到,4D 成像雷达可以输出带有高度的目标点云,反映出目标的轮廓外形,与激光雷达的点云成像的原理不同,仅仅从毫米比雷达的点云并无法准确判断一个目标的外形等特征,但是其点云的散射特征具备一定规律。

其机器学习目标分类算法吸取了点云的几个特征:多普勒速度、点云强度分布,与距离有关的关联特征等。机器学习的特点是参数少,便于嵌入式分类,在分类算法数据集中的测试已经达到了很高的分类能力,对于行人达 95% 以上,特别是大型车辆分类达到了 99%。

与激光雷达点云相比,4D 雷达点云虽然比激光雷达的稀疏,但是探测距离更远,且包含了目标的速度信息。4D 毫米波雷达可以辅助实现目标 3D 轮廓外形特征检测。可以看到,在相同的场景下,激光雷达与毫米波雷达的点云分布有明显的区别。

李森最后强调,目前 4D 雷达也开始逐步走向市场,未来将属于 4D 毫米波雷达点云,因为其每个目标有更丰富的点云,肯定会在 L4 系统中发挥更重要的作用,也就是说,有助于大大提升毫米波雷达的感知系统地位。